Dit is het derde en laatste deel in onze reeks over het bouwen van vertrouwen in dataplatformen. In het eerste artikel zagen we dat we vertrouwen absoluut meetbaar moeten maken. In het tweede artikel bouwden we een stevige basis door data te behandelen als een product. Nu is het tijd voor de ultieme test. Hoe houd je de autonome systemen zelf veilig onder controle?

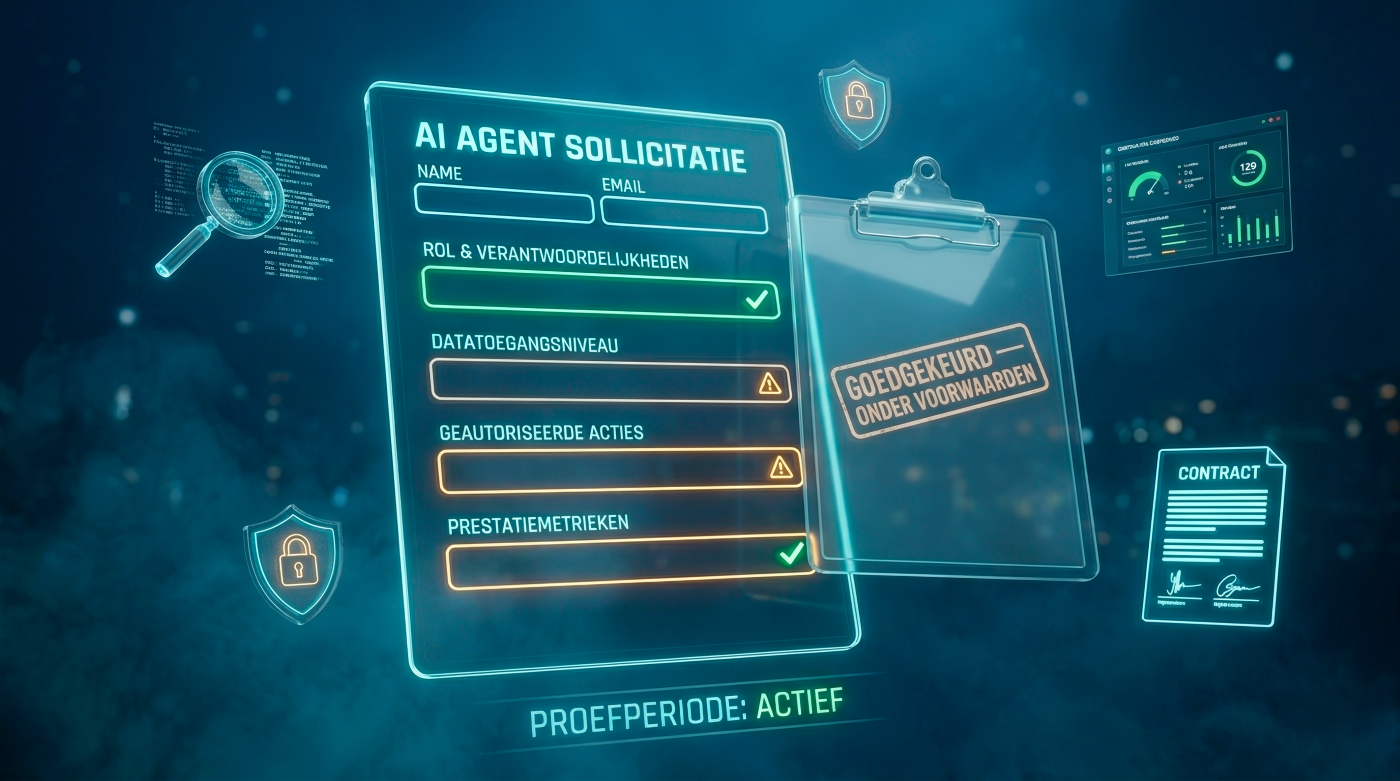

Een sollicitatiegesprek met je AI-agent

Behandel kunstmatige intelligentie als een collega

Je gebruikt een geavanceerde AI-agent niet zomaar als een handige tool. Je delegeert daadwerkelijk autoriteit. De software redeneert op basis van data en handelt vervolgens autonoom. Daarbij schalen eventuele fouten helaas net zo hard mee als de successen. Dat vormt een enorm risico.

Toch geven veel organisaties deze systemen blind toegang tot acties en data. Ze hopen simpelweg dat de technologie de juiste keuzes maakt. Bij een menselijke collega zou je zoiets nooit doen. Het is daarom tijd voor een verandering in onze denkwijze. Behandel je intelligente systemen vanaf vandaag als werknemers.

Tijd voor een pittig sollicitatiegesprek

Stel je voor dat een agent bij je komt solliciteren. Je neemt zo’n kandidaat uiteraard niet aan zonder een grondig gesprek. Je stelt gerichte vragen over de beoogde functie.

Wat is je exacte rol en wat zijn je verantwoordelijkheden? Welke data mag je gebruiken en welke absoluut niet? Wat zijn de harde grenzen van je bevoegdheid? Hoe meten we achteraf of je goed functioneert? Door dit gesprek letterlijk te voeren haal je de technologie uit de blackbox. Je ontwerpt vooraf een helder contract. Dat is de absolute basis voor gecontroleerde autonomie. Wil je hier zelf mee aan de slag? Bekijk dan ook onze Agent Workshop.

Papieren regels werken niet voor software

Afspraken maken is één ding. De naleving ervan garanderen in de praktijk is een tweede. Veel organisaties hebben hun bedrijfsbeleid nog altijd vastgelegd in statische documenten. Een mens kan zo’n beleidsstuk interpreteren, de nuance begrijpen en naar eigen inzicht toepassen.

Een agent kan zo’n statisch beleidsstuk echter niet zelfstandig interpreteren tijdens het werk. Als je governance handmatig blijft en je beslissingen autonoom worden, ontstaat er een gevaarlijke kloof. Omdat het systeem de ongeschreven regels niet kan ‘lezen’, zal het eventuele fouten of ongeoorloofde acties razendsnel en op grote schaal kunnen gaan herhalen. Je schaalt dan simpelweg de risico’s van je organisatie.

Maak je beleid en datakwaliteit leesbaar voor machines

Je moet de regels daarom digitaal en automatisch afdwingbaar maken. We noemen dit machine-readable governance. Je legt de kaders en restricties direct vast in de code en de metadata.

Denk aan automatische controles op de datakwaliteit en het direct afschermen van privacygevoelige informatie. Koppel daar beleid aan dat de software simpelweg blokkeert als een actie buiten de afgesproken kaders valt. Zodra het systeem een grens dreigt te overschrijden, grijpen je automatische kaders direct in. Zo borg je het vertrouwen in de techniek.

Houd continu zicht op de acties

Zodra de agent aan de slag gaat, ben je er nog niet. Je laat een nieuwe collega op zijn eerste dag ook niet direct de belangrijkste processen overnemen. Je bouwt een inwerkperiode in en voert periodieke evaluaties uit.

Voor autonome systemen heet dit observability. Je moet een virtuele controlekamer inrichten. Zorg dat je continu ziet welke beslissingen de software neemt en op basis van welke signalen dit gebeurt. Bouw een strakke feedbackloop in. Zo leert het systeem continu van zijn ervaringen en kun je als organisatie altijd tijdig bijsturen of ingrijpen.

Vertrouwen als de motor van innovatie

Vertrouwen is geen blokkade op de weg naar vooruitgang. Het is de ultieme versneller voor je organisatie. Zodra je vertrouwen meetbaar maakt en je systemen heldere kaders geeft, kun je pas echt veilig opschalen. Je schaalt dan niet langer je risico’s op maar juist je duurzame successen.

Loop je zelf vast bij het inrichten van zo’n betrouwbaar dataplatform? Of wil je gewoon eens sparren over het gecontroleerd inzetten van AI-agents? In onze Agent Workshop helpen we je hands-on op weg. Neem gerust contact op. We denken graag met je mee over de juiste aanpak voor jouw organisatie.